robots协定

robots.txt一般指本词条

Robots协定(也称为爬虫协定、机器人协定等)的全称是“网路爬虫排除标準”(Robots Exclusion Protocol),网站通过Robots协定告诉搜寻引擎哪些页面可以抓取,哪些页面不能抓取。

简介

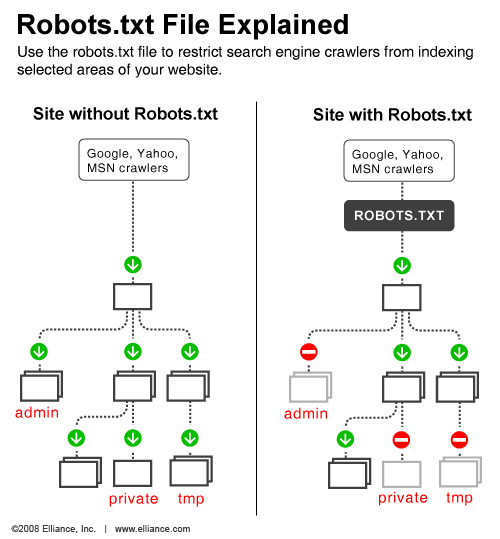

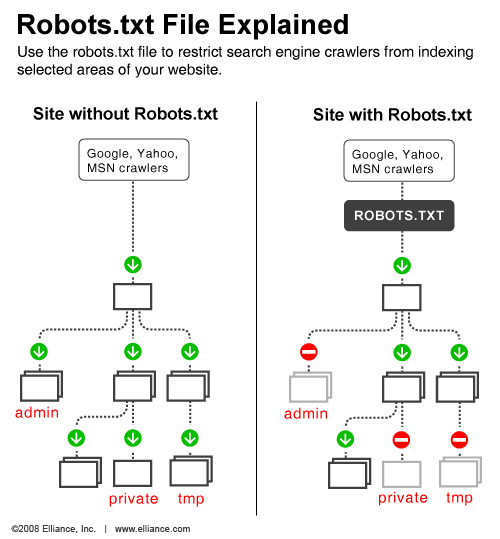

robots.txt档案是一个文本档案,使用任何一个常见的文本编辑器,比如Windows系统自带的Notepad,就可以创建和编辑它。robots.txt是一个协定,而不是一个命令。robots.txt是搜寻引擎中访问网站的时候要查看的第一个档案。robots.txt档案告诉蜘蛛程式在伺服器上什幺档案是可以被查看的。

当一个搜寻蜘蛛访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,如果存在,搜寻机器人就会按照该档案中的内容来确定访问的範围;如果该档案不存在,所有的搜寻蜘蛛将能够访问网站上所有没有被口令保护的页面。百度官方建议,仅当您的网站包含不希望被搜寻引擎收录的内容时,才需要使用robots.txt档案。如果您希望搜寻引擎收录网站上所有内容,请勿建立robots.txt档案。

如果将网站视为酒店里的一个房间,robots.txt就是主人在房间门口悬挂的“请勿打扰”或“欢迎打扫”的提示牌。这个档案告诉来访的搜寻引擎哪些房间可以进入和参观,哪些房间因为存放贵重物品,或可能涉及住户及访客的隐私而不对搜寻引擎开放。但robots.txt不是命令,也不是防火墙,如同守门人无法阻止窃贼等恶意闯入者。

原则

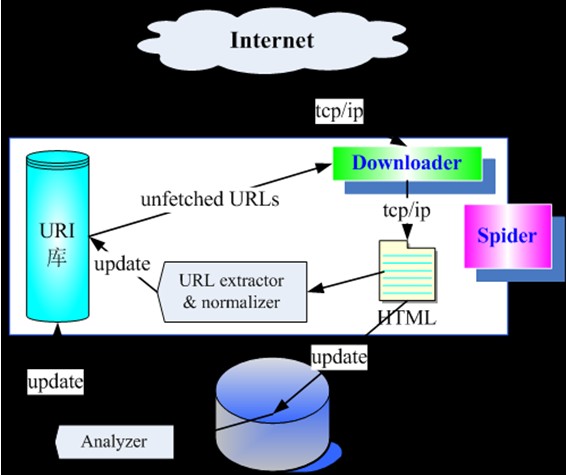

Robots协定是国际网际网路界通行的道德规範,基于以下原则建立: robots协定原理

robots协定原理

robots协定原理

robots协定原理1、搜寻技术应服务于人类,同时尊重信息提供者的意愿,并维护其隐私权;

2、网站有义务保护其使用者的个人信息和隐私不被侵犯。

功能

Robots协定用来告知搜寻引擎哪些页面能被抓取,哪些页面不能被抓取;可以禁止一些网站中比较大的档案,如:图片,音乐,视频等,节省伺服器频宽;可以禁止站点的一些死连结。方便搜寻引擎抓取网站内容;设定网站地图连线,方便引导蜘蛛爬取页面。

档案写法

User-agent: * 这里的*代表的所有的搜寻引擎种类,*是一个通配符

Disallow: /admin/ 这里定义是禁止爬寻admin目录下面的目录

Disallow: /require/ 这里定义是禁止爬寻require目录下面的目录

Disallow: /ABC/ 这里定义是禁止爬寻ABC目录下面的目录

Disallow: /cgi-bin/*.htm 禁止访问/cgi-bin/目录下的所有以".htm"为后缀的URL(包含子目录)。

Disallow: /*?* 禁止访问网站中所有包含问号 (?) 的网址

Disallow: /.jpg$ 禁止抓取网页所有的.jpg格式的图片

Disallow:/ab/adc.html 禁止爬取ab资料夹下面的adc.html档案。

Allow: /cgi-bin/ 这里定义是允许爬寻cgi-bin目录下面的目录

Allow: /tmp 这里定义是允许爬寻tmp的整个目录

Allow: .htm$ 仅允许访问以".htm"为后缀的URL。

Allow: .gif$ 允许抓取网页和gif格式图片

Sitemap: 网站地图 告诉爬虫这个页面是网站地图

档案用法

例1. 禁止所有搜寻引擎访问网站的任何部分

User-agent: *

Disallow: /

实例分析:淘宝网的 Robots.txt档案

User-agent: Baiduspider

Disallow: /

User-agent: baiduspider

Disallow: /

很显然淘宝不允许百度的机器人访问其网站下其所有的目录。

例2. 允许所有的robot访问 (或者也可以建一个空档案 “/robots.txt” file)

User-agent: *

Allow: /

例3. 禁止某个搜寻引擎的访问

User-agent: BadBot

Disallow: /

例4. 允许某个搜寻引擎的访问

User-agent: Baiduspider

allow:/

例5.一个简单例子

在这个例子中,该网站有三个目录对搜寻引擎的访问做了限制,即搜寻引擎不会访问这三个目录。

需要注意的是对每一个目录必须分开声明,而不要写成 “Disallow: /cgi-bin/ /tmp/”。

User-agent:后的*具有特殊的含义,代表“any robot”,所以在该档案中不能有“Disallow: /tmp/*” or “Disallow:*.gif”这样的记录出现。

User-agent: *

Disallow: /cgi-bin/

Disallow: /tmp/

Disallow: /~joe/

Robot特殊参数:

允许 Googlebot:

如果您要拦截除Googlebot以外的所有漫游器不能访问您的网页,可以使用下列语法:

User-agent:

Disallow: /

User-agent: Googlebot

Disallow:

Googlebot 跟随指向它自己的行,而不是指向所有漫游器的行。

“Allow”扩展名:

Googlebot 可识别称为“Allow”的 robots.txt 标準扩展名。其他搜寻引擎的漫游器可能无法识别此扩展名,因此请使用您感兴趣的其他搜寻引擎进行查找。“Allow”行的作用原理完全与“Disallow”行一样。只需列出您要允许的目录或页面即可。

您也可以同时使用“Disallow”和“Allow”。例如,要拦截子目录中某个页面之外的其他所有页面,可以使用下列条目:

User-agent: Googlebot

Allow: /folder1/myfile.html

Disallow: /folder1/

这些条目将拦截 folder1 目录内除 myfile.html 之外的所有页面。

如果您要拦截 Googlebot 并允许 Google 的另一个漫游器(如 Googlebot-Mobile),可使用”Allow”规则允许该漫游器的访问。例如:

User-agent: Googlebot

Disallow: /

User-agent: Googlebot-Mobile

Allow:

使用 * 号匹配字元序列:

您可使用星号 (*) 来匹配字元序列。例如,要拦截对所有以 private 开头的子目录的访问,可使用下列条目: User-Agent: Googlebot

Disallow: /private*/

要拦截对所有包含问号 (?) 的网址的访问,可使用下列条目:

User-agent: *

Disallow: /*?*

使用 $ 匹配网址的结束字元

您可使用 $字元指定与网址的结束字元进行匹配。例如,要拦截以 .asp 结尾的网址,可使用下列条目: User-agent: Googlebot

Disallow: /*.asp$

您可将此模式匹配与 Allow 指令配合使用。例如,如果 ? 表示一个会话 ID,您可排除所有包含该 ID 的网址,确保 Googlebot 不会抓取重複的网页。但是,以 ? 结尾的网址可能是您要包含的网页版本。在此情况下,可对 robots.txt 档案进行如下设定:

User-agent: *

Allow: /*?$

Disallow: /*?

Disallow: / *?

一行将拦截包含 ? 的网址(具体而言,它将拦截所有以您的域名开头、后接任意字元串,然后是问号 (?),而后又是任意字元串的网址)。

Allow: /*?$ 一行将允许包含任何以 ? 结尾的网址(具体而言,它将允许包含所有以您的域名开头、后接任意字元串,然后是问号 (?),问号之后没有任何字元的网址)。

儘管robots.txt已经存在很多年了,但是各大搜寻引擎对它的解读都有细微差别。Google与百度都分别在自己的站长工具中提供了robots工具。如果您编写了robots.txt档案,建议您在这两个工具中都进行测试,因为这两者的解析实现确实有细微差别。

其它属性

1. Robot-version: 用来指定robot协定的版本号

例子: Robot-version: Version 2.0

2.Crawl-delay:雅虎YST一个特定的扩展名,可以通过它对我们的抓取程式设定一个较低的抓取请求频率。您可以加入Crawl-delay:xx指示,其中,“XX”是指在crawler程式两次进入站点时,以秒为单位的最低延时。

3. Visit-time:只有在visit-time指定的时间段里,robot才可以访问指定的URL,否则不可访问.

例子: Visit-time: 0100-1300 #允许在凌晨1:00到13:00访问

4. Request-rate: 用来限制URL的读取频率

例子: Request-rate: 40/1m 0100 - 0759 在1:00到07:59之间,以每分钟40次的频率进行访问

Request-rate: 12/1m 0800 - 1300 在8:00到13:00之间,以每分钟12次的频率进行访问

标籤

Robots.txt档案主要是限制整个站点或者目录的搜寻引擎访问情况,而Robots Meta标籤则主要是针对一个个具体的页面。和其他的META标籤(如使用的语言、页面的描述、关键字等)一样,Robots Meta标籤也是放在页面中,专门用来告诉搜寻引擎ROBOTS如何抓取该页的内容。

Robots Meta标籤中没有大小写之分,name=”Robots”表示所有的搜寻引擎,可以针对某个具体搜寻引擎写为name=”BaiduSpider”。content部分有四个指令选项:index、noindex、follow、nofollow,指令间以“,”分隔。

index指令告诉搜寻机器人抓取该页面;

follow指令表示搜寻机器人可以沿着该页面上的连结继续抓取下去;

Robots Meta标籤的预设值是index和follow,只有inktomi除外,对于它,预设值是index、nofollow。

注意事项

上述的robots.txt和Robots Meta标籤限制搜寻引擎机器人(ROBOTS)抓取站点内容的办法只是一种规则,需要搜寻引擎机器人的配合才行,并不是每个ROBOTS都遵守的。目前看来,绝大多数的搜寻引擎机器人都遵守robots.txt的规则,而对于Robots META标籤,支持的并不多,但是正在逐渐增加,如着名搜寻引擎GOOGLE就完全支持,而且GOOGLE还增加了一个指令“archive”,可以限制GOOGLE是否保留网页快照。

位置

robots.txt档案应该放置在网站根目录下。举例来说,当spider访问一个网站时,首先会检查该网站中是否存在robots.txt这个档案,如果 Spider找到这个档案,它就会根据这个档案的内容,来确定它访问许可权的範围。

wordpress的robots位置

没有在wordpress网站根节目上传过robots.txt,当搜寻引擎和用户拜访某个档案时,wordpress程式会主动生成一个robots.txt给搜寻引擎和用户;若是我们上传编写的robots.txt到网站根节目,用户和搜寻引擎蛛蛛拜访的就是我们上传的档案,wordpress就不会再产生那个档案了。只有伺服器找不到robots的时候wordpress才会生成这个档案。

产生

robots.txt并不是某一个公司制定的,而是早在20世纪93、94年就早已出现,当时还没有Google。真实Robots协定的起源,是在网际网路从业人员的公开邮件组里面讨论并且诞生的。即便是今天,网际网路领域的相关问题也仍然是在一些专门的邮件组中讨论,并产生(主要是在美国)。

1994年6月30日,在经过搜寻引擎人员以及被搜寻引擎抓取的网站站长共同讨论后,正式发布了一份行业规範,即robots.txt协定。在此之前,相关人员一直在起草这份文档,并在世界网际网路技术邮件组发布后,这一协定被几乎所有的搜寻引擎採用,包括最早的altavista,infoseek,后来的google,bing,以及中国的百度,搜搜,搜狗等公司也相继採用并严格遵循。

Robot,又称Spider,是搜寻引擎自动获取网页信息的电脑程式的通称。Robots协定的核心思想就是要求Robot程式不要去检索那些站长们不希望被直接搜寻到的内容。将约束Robot程式的具体方法规範成格式代码,就成了Robots协定。一般来说,网站是通过Robots.txt档案来实现Robots协定。

自有搜寻引擎之日起,Robots协定已是一种目前为止最有效的方式,用自律维持着网站与搜寻引擎之间的平衡,让两者之间的利益不致过度倾斜。它就像一个钟摆,让网际网路上的搜寻与被搜寻和谐相处。

维基百科上描述的robots协定的最原始起源

维基百科上描述的robots协定的最原始起源影响

Robots协定是网站出于安全和隐私考虑,防止搜寻引擎抓取敏感信息而设定的。搜寻引擎的原理是通过一种爬虫spider程式,自动蒐集网际网路上的网页并获取相关信息。而鑒于网路安全与隐私的考虑,每个网站都会设定自己的Robots协定,来明示搜寻引擎,哪些内容是愿意和允许被搜寻引擎收录的,哪些则不允许。搜寻引擎则会按照Robots协定给予的许可权进行抓取。

Robots协定代表了一种契约精神,网际网路企业只有遵守这一规则,才能保证网站及用户的隐私数据不被侵犯。违背Robots协定将带来巨大安全隐忧——此前,曾经发生过这样一个真实的案例:国内某公司员工郭某给别人发了封求职的电子邮件,该Email存储在某邮件服务公司的伺服器上。因为该网站没有设定robots协定,导致该Email被搜寻引擎抓取并被网民搜寻到,为郭某的工作生活带来极大困扰。

如今,在中国国内网际网路行业,正规的大型企业也都将Robots协定当做一项行业标準,国内使用Robots协定最典型的案例,就是淘宝网拒绝百度搜寻、京东拒绝一淘搜寻。不过,绝大多数中小网站都需要依靠搜寻引擎来增加流量,因此通常并不排斥搜寻引擎,也很少使用Robots协定。

北京市汉卓律师事务所首席律师赵虎表示,Robots协定是维护网际网路世界隐私安全的重要规则。如果这种规则被破坏,对整个行业就是灭顶之灾。

搜寻引擎

百度对robots.txt是有反应的,但比较慢,在减少禁止目录抓取的同时也减少了正常目录的抓取。

原因应该是入口减少了,正常目录收录需要后面再慢慢增加。

Google对robots.txt反应很到位,禁止目录马上消失了,部分正常目录收录马上上升了。/comment/目录收录也下降了,还是受到了一些老目标减少的影响。

搜狗抓取呈现普遍增加的均势,部分禁止目录收录下降了。

总结一下:Google似乎最懂站长的意思,百度等其它搜寻引擎只是被动的受入口数量影响了。

淘宝封杀

2008年9月8日,淘宝网宣布封杀百度爬虫,百度忍痛遵守爬虫协定。因为一旦破坏协定,用户的隐私和利益就无法得到保障,搜寻网站就谈不到人性关怀。

京东封杀

2011年10月25日,京东商城正式将一淘网的搜寻爬虫禁止,以防止一淘网对其的内容抓取。

违反事例

BE违规抓取eBay

在12年前,美国加州北部的联邦地方法院就在着名的eBayVS. Bidder's Edge案中(NO.C-99-21200RMW,2000 U.S Dist. LEXI 7282),引用robots协定对案件进行裁定。 Bidder's Edge(简称BE)成立于1997年,是专门提供拍卖信息的聚合网站。12年前,BE利用“蜘蛛”抓取来自eBay等各个大型拍卖网站的商品信息,放在自己的网站上供用户浏览,并获得可观的网站流量。

对于eBay来说,来自BE蜘蛛每天超过十万次的访问,给自己的伺服器带来了巨大的压力。而虽然eBay早已设定了robots协定禁止BE蜘蛛的抓取,但BE却无视这个要求——原因很简单,据估算,BE网站69%的拍卖信息都来自eBay, 如果停止抓取eBay内容,这意味着BE将损失至少三分之一的用户。

数次沟通交涉未果后,2000年2月,忍无可忍的eBay终于一纸诉状,将BE告上联邦法庭,要求禁止BE的违规抓取行为。3个月后,受理此案的美国联邦法官Ronald M. Whyte在经过多方调查取证后做出裁定,认定BE侵权成立,禁止了BE在未经eBay允许的情况下,通过任何自动查询程式、网路蜘蛛等设定抓取eBay的拍卖内容。

在当时的庭审中,双方争议的焦点主要集中在“网站是否有权设定robots协定禁止其他网站蜘蛛的抓取”。被告BE认为,eBay的网站内容属于网民自创,因此是公共资源,eBay无权设立robots协定进行限制。然而,法院对这一说辞却并不认同。在法官看来:“eBay 的网站内容属于私有财产,eBay有权通过robots协定对其进行限制。”违规抓取的行为无异于“对于动产的非法侵入”。

也正是出于这一判断,即使当年BE还只是搜寻了eBay计算机系统里的一小部分数据,其违反robots协定的抓取行为,仍然被判为侵犯了eBay将别人排除在其计算机系统以外的基本财产权。

作为美国历史上第一个保护网际网路信息内容的法律裁定,eBay与BE的这起纠纷,成为网路侵权案的标誌性案例,并在当时引发了美国网际网路产业乃至社会的广泛讨论。SearchEngine Watch的知名专栏作家DannySullivan 曾专门在文章中指出,robots协定是规範搜寻引擎爬虫行为的极少数约定之一,理应遵守,它不仅仅让整个网际网路的开放性变成可能,最终也让整个网际网路用户受益。

360搜寻无视robots协定

2012年8月,360综合搜寻被指违反robots协定: 360甘冒行业道德风险 撕毁Robots自律协定

360甘冒行业道德风险 撕毁Robots自律协定

360甘冒行业道德风险 撕毁Robots自律协定

360甘冒行业道德风险 撕毁Robots自律协定2012年8月29日,上线不到十日即轻鬆登上国内第二大搜寻引擎宝座的奇虎360搜寻遭遇滑铁卢,在百度一项打击违规抓取和匿名访问的措施上线后,360搜寻通过山寨加绑架用户的模式被彻底揭穿,这个故事也正是对所谓“搜寻引擎技术无用论”的当头棒喝。

“360综合搜寻已超出Robots协定的‘底线’,不仅未经授权大量抓取百度、google内容,还记录国内知名网游的后台订单、优惠码等,甚至一些用户的电子信箱、帐号、密码也被360通过浏览器悄然记录在案”。2012年8月28日业内一位有10年搜寻工程师经验的专业人士表示。

奇虎360搜寻8月16 日上线,已连续遭到业界“违规”的警告。不仅UI设计,搜寻结果直接剽窃、篡改百度、google等搜寻引擎,还不顾国际通行的Robots协定,抓取百度、google等搜寻引擎的内容,很多商业网站和个人信息的私密内容也被抓取泄密。据悉,这种匿名访问和违规抓取其他网站内容的行为,不仅严重违反了行业底线,也伤害到了用户的体验。在国外,这种行为甚至会受到法律方面的制裁。“这已经严重触碰了Robots协定的底线!这些让如百度这样踏踏实实做技术的公司进行反击行动,是必然的!”

这位搜寻工程师告诉记者,所谓Robots协定,通俗的讲就是网站会通过robots.txt协定来自主控制是否愿意被搜寻引擎收录,或者指定搜寻引擎只收录指定的内容。而搜寻引擎会按照每个网站主给与自己的许可权来进行抓取。这就好比,一个正常的人去到别人家里,需要先敲门,得到许可以后才能进入客厅。除非有主人的进一步许可和邀请,否则你不能擅自进入内室,或者在别人家里四处溜达。当然,强盗或者小偷例外。

对于奇虎360综合搜寻被爆出无视国际通行的robots协定,抓取百度、Google等搜寻引擎内容,导致众多网站出于安全和隐私考虑不允许搜寻引擎抓取的区域网路信息被泄露一事,资深网际网路观察家洪波指出,做搜寻就要遵守搜寻行业公认的游戏规则,无视规则,肆意违反规则才是真正的不正当竞争,这种行为不能从法律和政府监管上及时制止,将引发行业大乱。

百度并没有禁止所有爬虫抓取问答、知道和贴吧的内容,百度只是禁止了不规矩的、存在潜在安全风险的爬虫,这恰是保护市场秩序,保护用户隐私的合理举措。2008年淘宝也曾禁止百度爬虫,而百度则严格遵守robots协定,停止抓取淘宝网内容,并没有以淘宝不正当竞争为藉口违反robots协定。

中国工程院院士高文:Robots协定是搜寻引擎在抓取网站信息时要遵守的一个规则,是国际网际网路界通行的道德规範。网站主人通过Robots协定明示自动抓取程式,伺服器上什幺内容可以被抓取,什幺内容不可以被抓取。这是保证网际网路行业健康发展的自律準则,儘管不是强制命令,但业界都应该遵守。中国网际网路企业要想在国际舞台受到更多关注、得到更大的发展,没有理由不遵守这个游戏规则。如果不遵守,不仅损害了违规企业自身的形象,也损害了中国网际网路行业的整体声誉,得不偿失。

浙江大学计算机学院院长庄越挺:网际网路网站页面,如同广阔农村中的一个菜园,各有其主。一般而言,访客进去逛逛无可厚非,但是如果主人在边界立下界碑:未经允许不得入内,这就意味着主人的意愿成为外界是否获準入园参观的标準。Robots协定就是这样一块界碑,它虽然不具法律效应,但是人们都普遍遵循。未经允许入园就参观不仅违反了游戏规则,也有违道德标準。同样的道理,违反Robots协定,等同于违背了搜寻引擎的行业规範,以这种方式获取资源是一种不道德的竞争。

哈尔滨工业大学教授刘挺:Robots协定是网际网路中网站为搜寻引擎所制定的内容抓取规则,体现了业界同行之间的相互信任。如果不遵循Robots协定,将会破其业界信任,使得网站的内容不愿意被抓取的内容被搜寻引擎索引,最终伤害用户的利益。而清华大学计算机系教授马少平则指出,如果不遵守Robots协定,肆意抓取网站的内容,网站的信息被任意泄漏,将对网际网路的良性发展产生巨大的破坏作用。

百度起诉360

百度诉奇虎360违反“Robots协定”抓取、複製其网站内容侵权一案,2013年10月16日上午在北京市第一中级人民法院开庭审理。百度方面认为,360搜寻在未获得百度公司允许的情况下,违反业内公认的Robots协定,抓取百度旗下百度知道、中文百科、百度贴吧等网站的内容,已经构成了不正当竞争,并向奇虎索赔1亿元。

百度公关部郭彪向媒体表示,Robots协定是网站信息和网民隐私保护的国际通行规範之一,理应得到全球网际网路公司的共同遵守。不尊重Robots协定将可能导致网民隐私大规模泄露。

郭彪表示,更严重的是,奇虎360还利用360浏览器等客户端,强行抓取网民的浏览数据和信息到搜寻伺服器,完全无视Robots协定。这一做法目前已经导致大量企业区域网路信息被泄露。2012年年底,百度工程师通过一个名为“鬼节捉鬼”的测试,证明了360浏览器存在私自上传“孤岛页面”等隐私内容到360搜寻的行为。

360方面则认为,360搜寻索引这些内容页面并不涉嫌侵犯百度的权益,实际上还为百度带来了大量的用户和流量,百度应该感谢360。

海之美文新闻资讯

海之美文新闻资讯